承接上文,接下来我们就来探讨一下Azure复述的迁移问题,复述本身是提供持久化的方法的,如AOF和RDB,但是在Azure复述中,AOF和RDB都是只有溢价版本才支持的功能,所以对于标准和基本的复述来说,需要能有一种更通用的迁移方式,微软官方并没有官宣提供Azure复述,迁移的工具,但是复述,团队的一名大佬还是自己写了一个开源的迁移工具,这次就拿来给大家分享一下。

这个工具本身也是公开在Github上的,以下是Github的地址,我们可以在这里下载到迁移工具

https://github.com/Azure/Azure-China-Migration-Playbook/blob/master/migrate/china-migration-guidance-databases.md

此方法比较适合Azure跨地区迁移,比如讲一个地区的复述,迁移到另外一个地区,下边来介绍下这个工具如何使用

首先来介绍下实验环境:

1。Azure复述,标准、地区chinanorth原地址

2。Azure复述,标准、地区chinanorth目标地址

3。工作用笔记本电脑一个

实验环境很简单,首先先在之前的地址上下载迁移工具

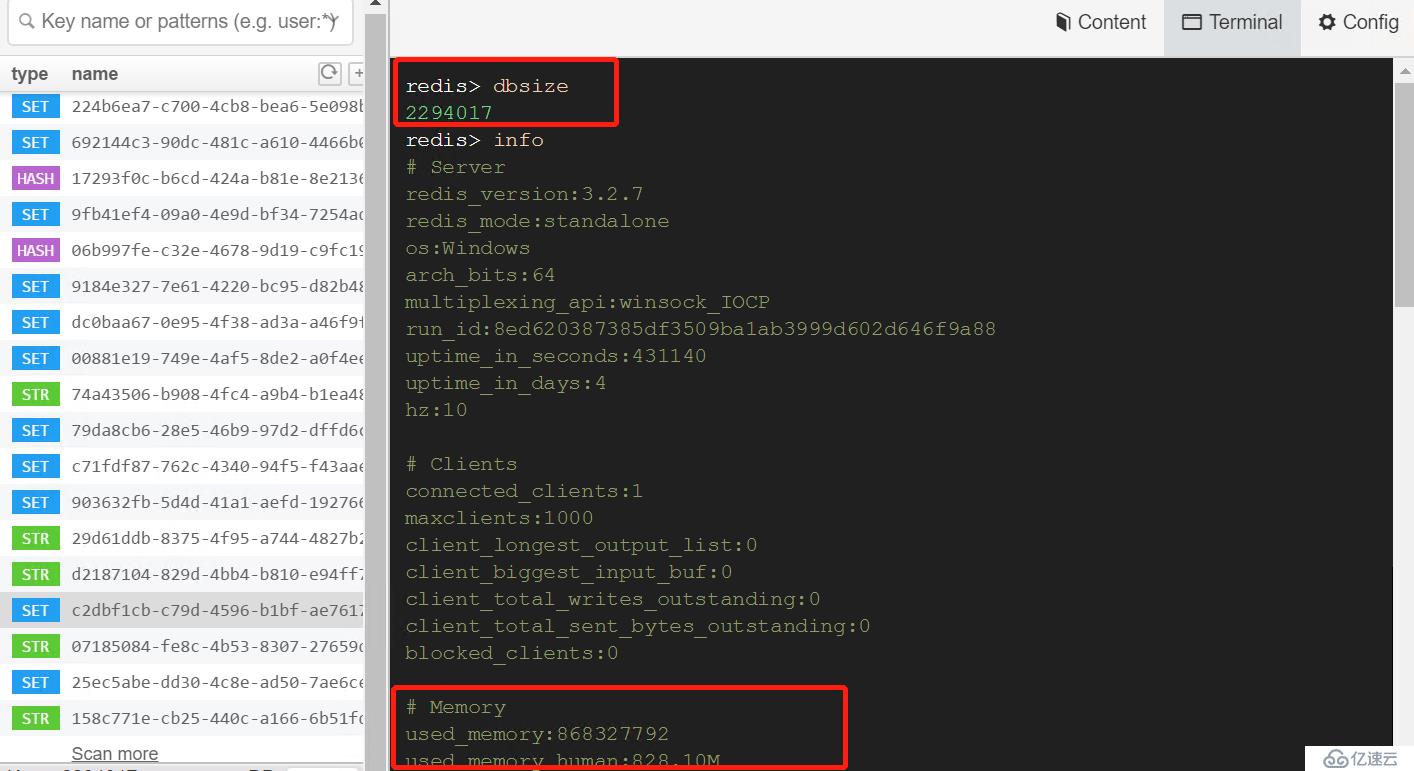

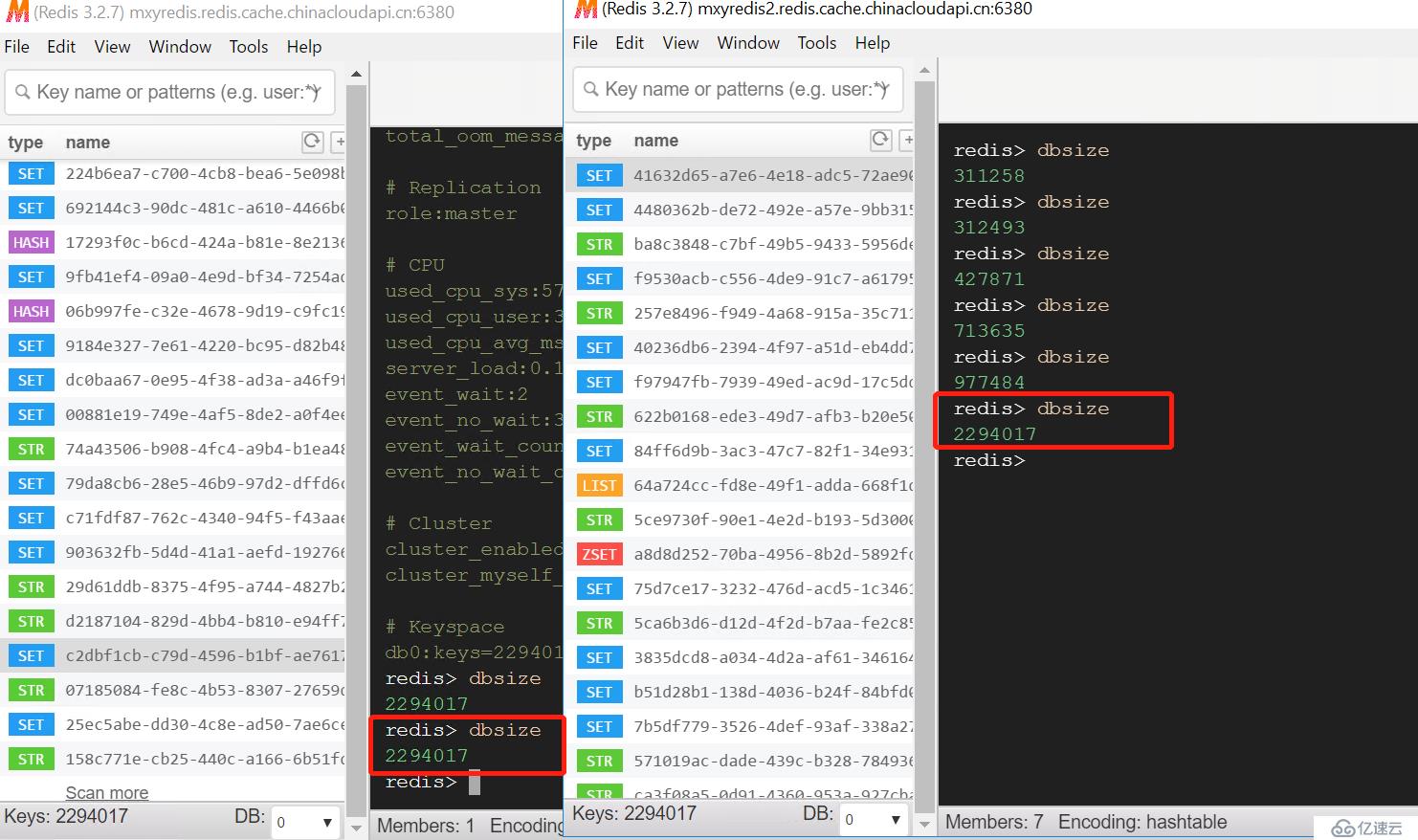

在上一节当中,我们已经使用随机数据生成程序,批量生成了200多万条数据,可以通过dbsize来查看

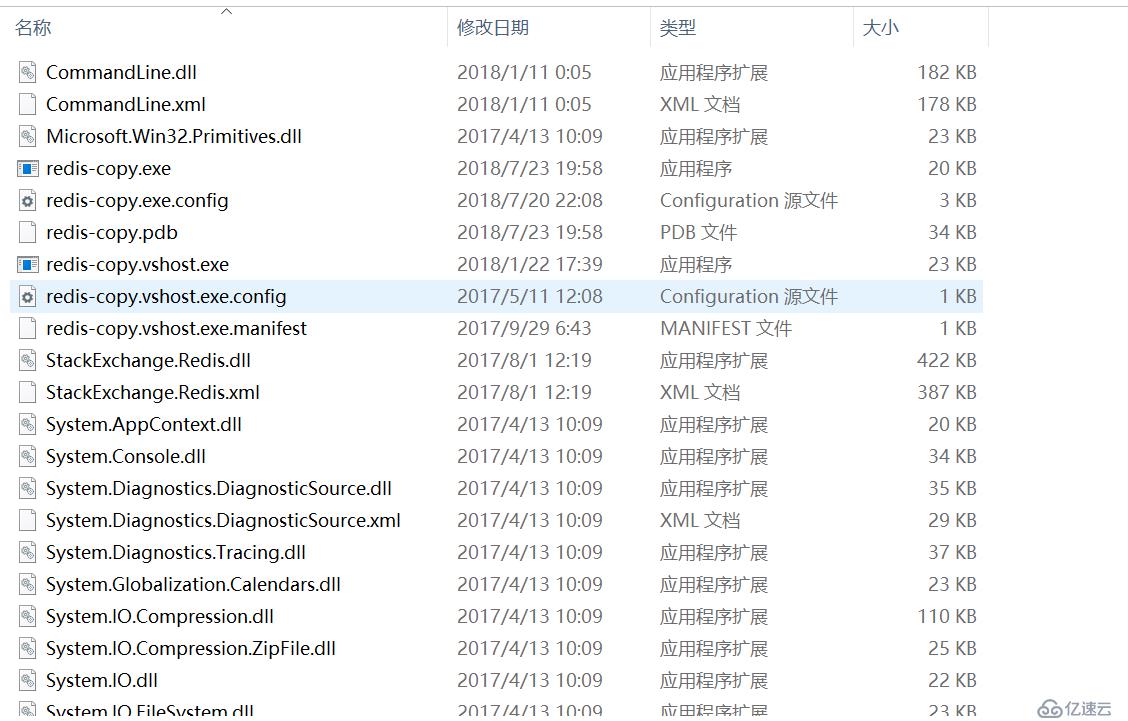

2。可以看到复述,迁移工具下载完成后,主要包含以下内容

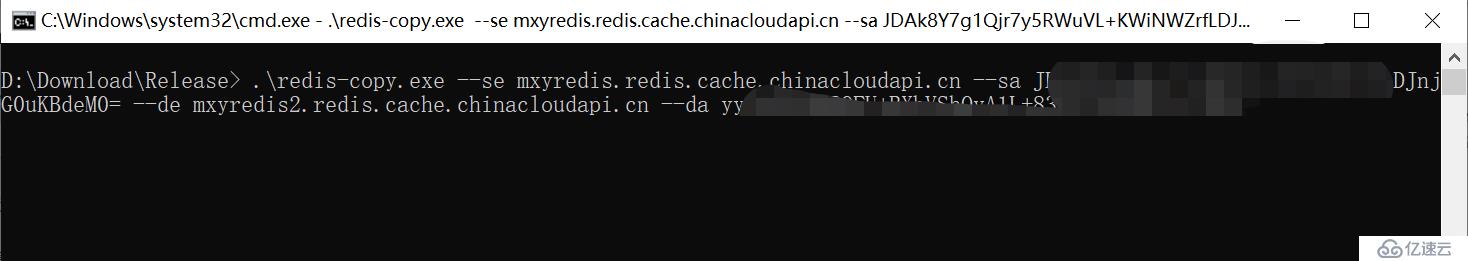

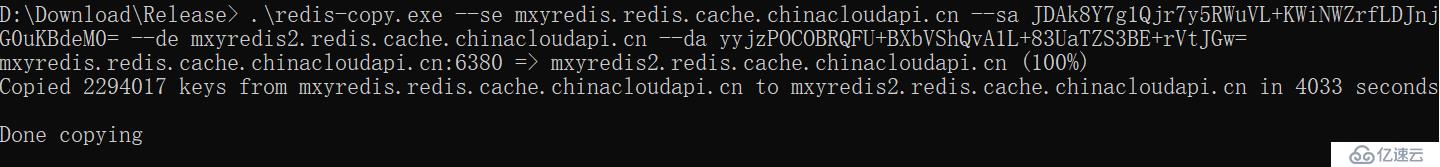

3。想要迁移的话很简单,运行redis-copy命令即可

。\ redis-copy。exe - se mxyredis.redis.cache.chinacloudapi.cn - sa J * * * *=- de mxyredis2.redis.cache.chinacloudapi.cn - da * * *

命令格式也很简单,只需要输入原地址,原服务器的关键,目标地址,目标服务器的关键即可

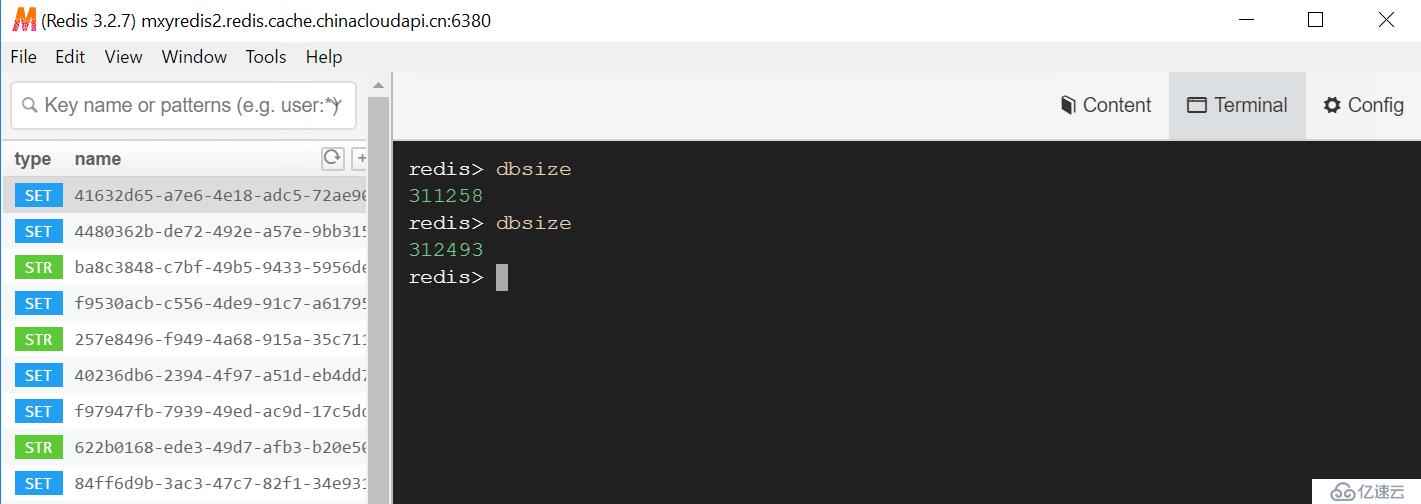

4。命令行工具迁移时不会有输出信息,但是在目标复述,可以看到数据量一直在增加

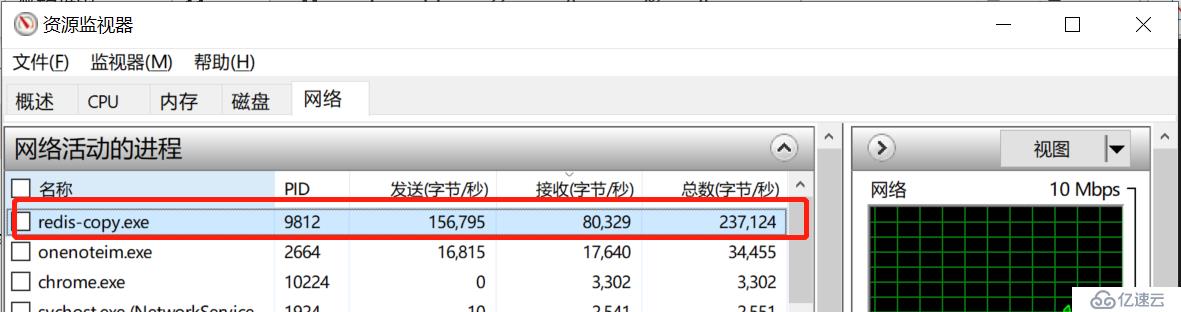

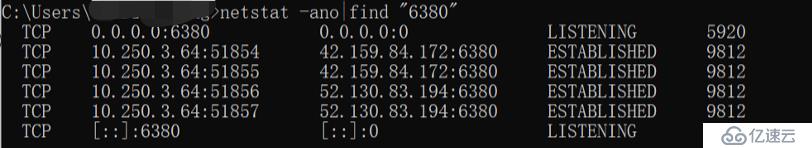

5。查看本机的资源监视器,可以看到本机和两台复述,都有连接,而且进出都有流量,这意味着,这个工具的原理是先把数据从原复述下载到本地,然后再上传到目标复述!并不是直接服务器对服务器直传的,所以这也代表,迁移的速度会受制于运行迁移工具的机器,所以想要速度快一些的话,最好在Azure上创建VM来运行脚本!实验也发现,通过公网的传输确实速度相对较慢,一小时才传输了不到1克数据

6。传输完成

7。可以看到两个节点数据是一致的了!迁移也就完成了

当然,需要注意的是,这个工具本身并不支持增量,再次运行的话还会把所有数据全部复制一次,不得不说,美中不足