目前深度学习应用广发,其中AI推理的在线服务是其中一个重要的可落地的应用场景。本文将为大家介绍使用函数计算部署深度学习AI推理的最佳实践,其中包括使用有趣的工具一键部署安装第三方依赖,一键部署,本地调试以及压测评估,全方位展现函数计算的开发敏捷特性,自动弹性伸缩能力,免运维和完善的监控设施。

1.1演示概述

通过上传一个猫或者狗的照片,识别出这个照片里面的动物是猫还是狗

-

<李>演示示例效果入口:http://sz.mofangdegisn.cn

<李>演示示例工程地址:https://github.com/awesome-fc/cat-dog-classify

<强>开通服务

免费开通函数计算,按量付费,函数计算有很大的免费额度。

免费开通文件存储服务NAS,按量付费

1.2解决方案

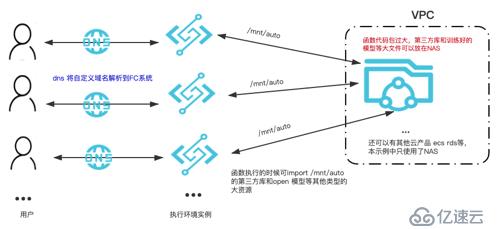

如上图所示,当多个用户通过对外提供的url访问推理服务时候,每秒的请求几百上千都没有关系,函数计算平台会自动伸缩,提供足够的执行实例来响应用户的请求,同时函数计算提供了完善的监控设施来监控您的函数运行情况。

1.3。Serverless方案与传统自建服务方案对比

1.3.1卓越的工程效率

自建服务 函数计算Serverless 基础设施 需要用户采购和管理 无 开发效率 除了必要的业务逻辑开发,需要自己建立相同线上运行环境,包括相关软件的安装,服务配置,安全更新等一系列问题 只需要专注业务逻辑的开发,配合有趣的工具一键资源编排和部署 学习上手成本 可能使用k8或弹性伸缩(ESS),需要了解更多的产品,名词和参数的意义 会编写对应的语言的函数代码即可1.3.2弹性伸缩免运维

自建服务 函数计算Serverless 弹性高可用 需要自建负载均衡(SLB)、弹性伸缩,扩容缩容速度较FC慢 FC系统固有毫秒级别弹性伸缩,快速实现底层扩容以应对峰值压力,免运维 监控报警查询 ECS级别的指标 提供更细粒度的函数执行情况,每次访问函数执行的延迟和日志等,更加完善的报警监控机制1.3.3更低的成本

-

<李>函数计算(FC)固有自动伸缩和负载均衡功能,用户不需要购买负载均衡(SLB)和弹性伸缩。

<李>具有明显波峰波谷的用户访问场景(比如只有部分时间段有请求,其他时间甚至没有请求),选择按需付费,只需为实际使用的计算资源付费。

对于明显波峰波谷或者稀疏调用具有低成本优势,同时还保持了弹性能力,以后业务规模做大以后并没有技术切换成本,同时财务成本增长配合预付费也能保持平滑。

<李>部分请求持续平稳的场景下,可以配合预付费解决按需付费较高单价问题。函数计算成本优化最佳实践文档。

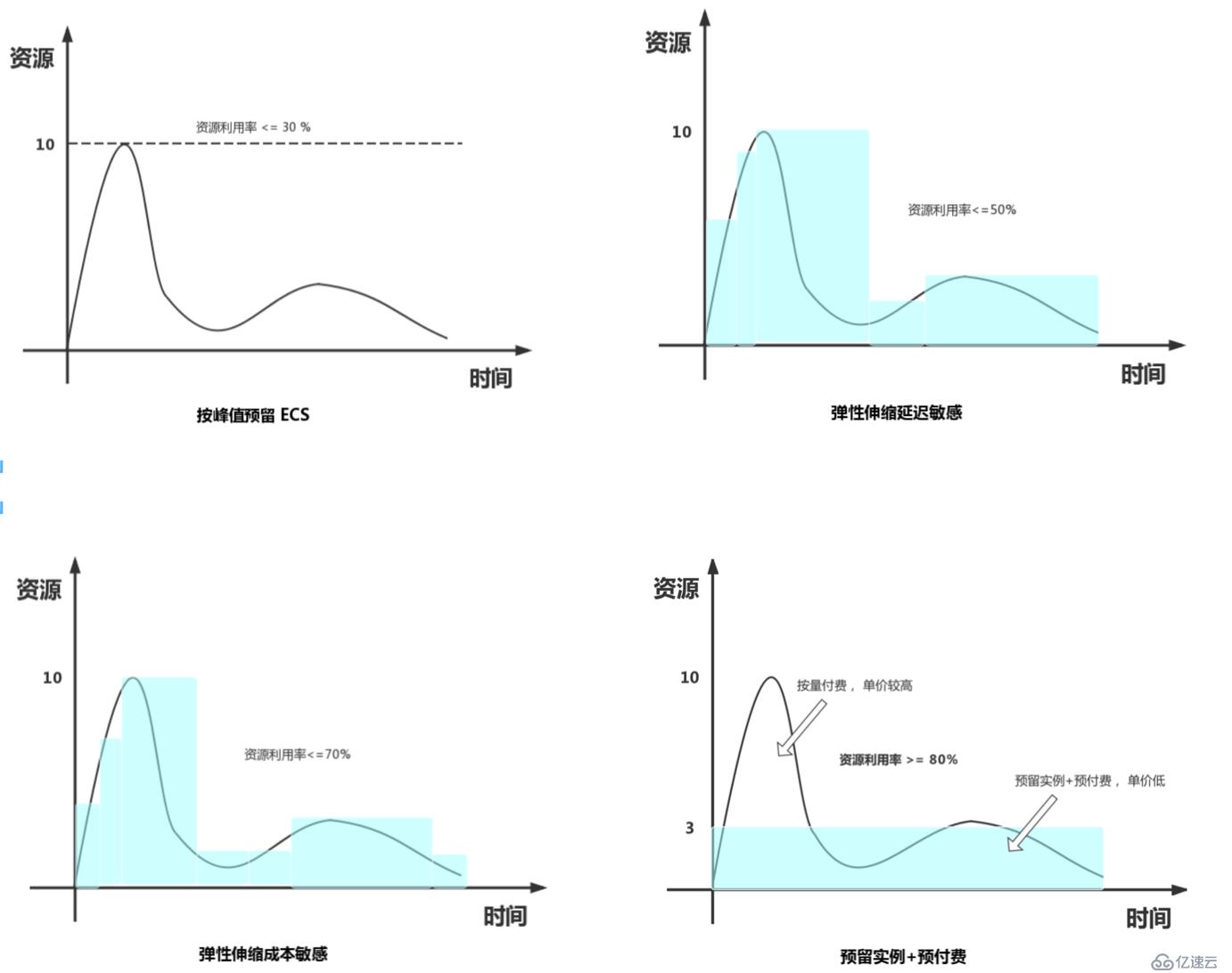

假设有一个在线计算服务,由于是CPU密集型计算,因此在这里我们将平均CPU利用率作为核心参考指标对成本,以一个月为周期,10台C5 ECS的总计算力为例,总的计算量约为30%场景下,各解决方案CPU资源利用率使用情况示意图大致如下:

由上图预估出如下计费模型:

<李>函数计算预付费3铜一个月:246.27元,计算能力等价于ECS计算型C5李 <李> ECS计算型C5(2个vcpu 4 gb) +云盘:包月219元,按量:446.4元李 <李>包月10 Mbps的SLB: 526.52元(这里做了一定的流量假设),弹性伸缩免费 <李>饱和使用下,函数计算按量付费的一台机器成本约为按量付费C5 ECS的2倍

平均CPU利用率 计算费用 SLB 总计 函数计算组合付费 祝辞=80% 738 + X (246.27 * 3 + X) 无 & lt;=738 + X 按峰值预留ECS & lt;=30% 2190 (10 * 219) 526.52 祝辞=2716.52 弹性伸缩延迟敏感 & lt;=50% 1314 (102193/5) 526.52 祝辞=1840.52 弹性伸缩成本敏感 & lt;=70% 938.57 (102193/7) 526.52 祝辞=1465.09使用函数计算三步实现深度学习AI推理在线服务