这篇文章将为大家详细讲解有关python分布式多爬虫系统怎么弄,小编觉得挺实用的,因此分享给大家做个参考,希望大家阅读完这篇文章后可以有所收获。

在爬虫的开发过程中,有些业务场景需要同时抓取几百个甚至上千个网站,此时就需要一个支持多爬虫的框架。以下将通过解释两张图来说明架构的设计思想。

,

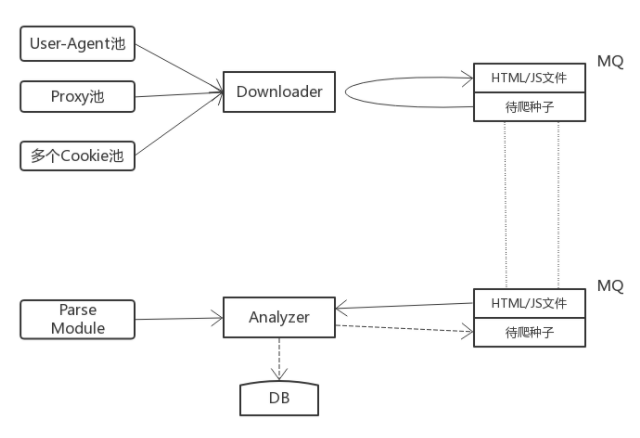

1,框架主要分成两部分:下载器下载器和解析器Analyzer.Downloader负责抓取网页,分析仪负责解析网页并入库。两者之间依靠消息队列MQ进行通信,两者可以分布在不同机器,也可分布在同一台机器。两者的数量也是灵活可变的,例如可能有五台机在做下载,两台机在做解析,这都是可以根据爬虫系统的状态及时调整的。

2,从上图可以看到MQ有两个管道:HTML/JS文件和待爬种子.Downloader从待爬种子里拿到一条种子,根据种子信息调用相应的抓取模块进行网页抓取,然后存入HTML/JS文件这个通道;分析器从HTML/JS文件里拿到一条网页内容,根据里面的信息调用相应的解析模块进行解析,将目标字段入库,需要的话还会解析出新的待爬种子加入MQ。

3,可以看到下载器是包含user - agent池代理池,饼干池的,可以适应复杂网站的抓取。

4模块的调用使用工厂模式。

,

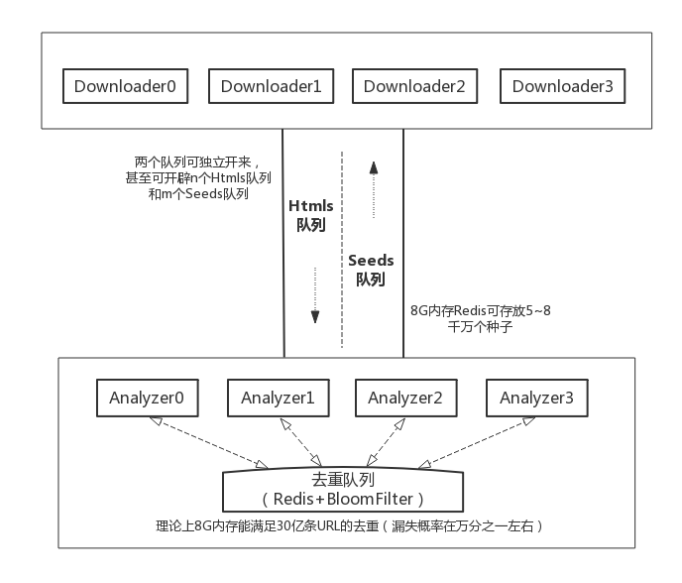

这张图是上一张图的另一种表述。

HTML队列和种子是队列可以独立分开,甚至数量也可以多开,之间没有联系。完全可以灵活地根据爬虫状态和硬件环境作调整。另外8 g的内容可以让复述,作为种子队列存放5 ~ 8千万个种子。

分布式爬虫非常关键的一点:去重。可以看到多个解析器分析仪共用一个去重队列,才能够保证数据的统一不重复。去重队列可以放在一台机上。基于复述,实现了Bloomfilter算法,理论上8 g的内存可以满足30个亿条URL的去重,如果允许漏失概率再大点的话能去重更多。

关于python分布式多爬虫系统怎么弄就分享到这里了,希望以上内容可以对大家有一定的帮助,可以学到更多知识。如果觉得文章不错,可以把它分享出去让更多的人看的到。