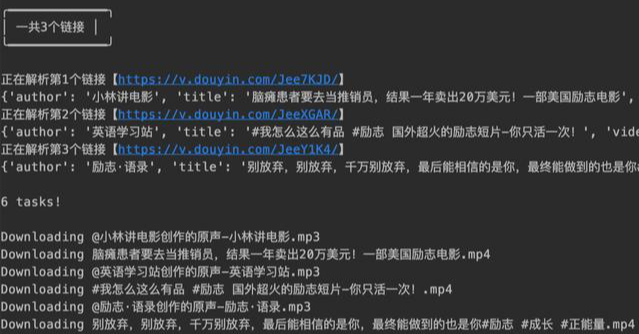

介绍,,,,path =,“。/爬取抖音/批量下载链接.txt"

,,,with 开放(路径,& # 39;" # 39;),as f:

,,,,,,,what =, f.read ()

,,,for 小姐:“1“拷贝:

,,,,,,,urls =, parse_url(什么)

,,,,,,,if not 网址:

,,,,,,,,,,,印刷(“再见~”)

,,,,,,,,,,,休息

,,,,,,,print (f"“;“

╭━━━━━━━━━━━━━╮

│,一共{len (url)}个链接,│

╰━━━━━━━━━━━━━╯

,,,,,,,,,,)

,,,,,,,all_task =, []

,,,,,,,for idx,, url 拷贝列举(url):

,,,,,,,,,,,印刷(f"正在解析第{idx + 1}个链接【{url}】“)

,,,,,,,,,,,data =, get_data (url)

,,,,,,,,,,,if 数据:

,,,,,,,,,,,,,,,all_task.extend (data2tasks(数据)

,,,,,,,queue =,队列(最大容量=100)

,,,,,,,for t 拷贝all_task:

,,,,,,,,,,,queue.put (t)

,,,,,,,ts =,(线程(目标=dl, arg游戏=(队列,,)),for _ 拷贝范围(最低(len (all_task), 6)))

,,,,,,,for t 拷贝ts:

,,,,,,,,,,,t.start ()

,,,,,,,for t 拷贝ts:

,,,,,,,,,,,t.join ()

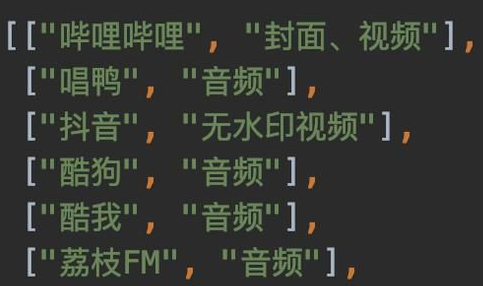

小编给大家分享一下怎么用python爬虫批量下载视频,相信大部分人都还不怎么了解,因此分享这篇文章给大家参考一下,希望大家阅读完这篇文章后大有收获、下面让我们一起去了解一下吧!

txt