今天就跟大家聊聊有关AI 复原100年前的京城老视频靠的是哪三个开源工具,可能很多人都不太了解,为了让大家更加了解,小编给大家总结了以下内容,希望大家根据这篇文章可以有所收获。

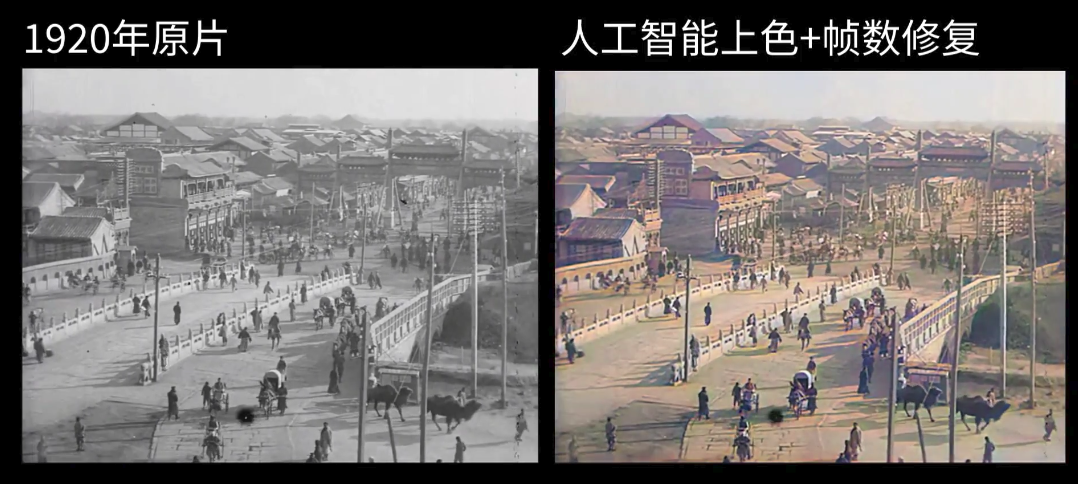

近日,一段拍摄于 100 年前的老北京城影像被央视转发,在微博上火了。据了解,该视频出自一位 B 站的 UP 主大谷的游戏创作小屋。作者大谷利用 AI 技术,把一段拍摄于 1920 年的北京城黑白视频,渲染成了高清流畅的彩色视频,配以颇具地方特色的 BGM,还原了百年前老北京城的民风民俗,颇有内味。

据大谷介绍,这部拍摄于百年前的黑白视频由于年代久远,视频画质有很多噪点,帧数、分辨率都很低。于是他使用了三款开源的 AI 工具来对视频进行处理,分别是:

DAIN,对视频进行补帧处理,提高视频流畅度

ESRGAN,对视频进行超分辨率处理,提高视频清晰度

DeOldify,对视频进行上色处理

下面就让我们来了解一下这三款视频修复常用的 AI 工具,感兴趣的朋友也可以学着用起来,自己处理老旧视频哦。

视频补帧工具 DAIN

帧数 (FPS)对于一部视频的流畅度来说影响很大,在正常播放速度下,低于 30 FPS 的视频会让人觉得卡顿,高于 60 FPS 的话肉眼则分辨不出区别。帧数越高的视频带来的流畅度一定是更高的,尤其是在慢镜头下,差别尤为明显:

上图来自另一 AI 补帧工具 SUPER SLOMO 的示例,将原片 30 FPS 的汽车甩尾镜头放慢 8 倍后,实际 FPS 不足 4 FPS,肉眼可见的卡顿。而通过 AI 补帧技术,能够将慢放后的视频维持在 240 FPS,流畅程度可见一斑。

通常来说,补帧的核心述求是在两个连续帧之间插入中间帧,从而提高视频的 FPS,而补帧工具需要解决的问题就是如何通过 AI 算法自动生成中间帧。DAIN 全称 Depth-Aware Video Frame Interpolation,即基于深度感知的视频帧插值工具。DAIN 团队提出了深度感知帧内插模型,开发了一个深度感知流投影层来生成中间帧。

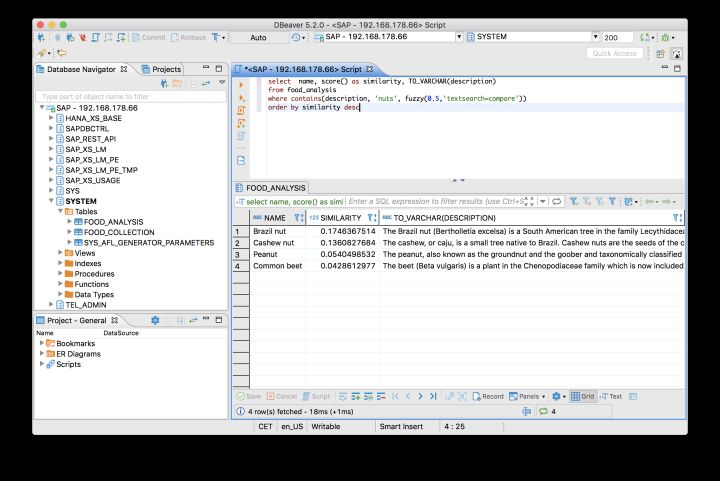

测试环境

Ubuntu(Ubuntu=16.04.5 LTS )

Python:Anaconda3=4.1.1 & Python=3.6.8

<李><强> Cuda和Cudnn :Cuda=9.0,, Cudnn=7.0,

<李><强> Pythorch :定制的深度感知流投影和其他层需要Pythorch中的阿托恩API=1.0.0

<李><强> GCC :编译PyTorch 1.0.0扩展文件(c/M?需要GCC=4.9.1和nvcc=9.0编译器

<李><强> GPU :NVIDIA GPU(作者使用的是泰坦X (Pascal)计算=6.1,支持compute_50/52/60/61设备)

<强>安装使用

下载资料库:

<>之前,美元git clone https://github.com/baowenbo/DAIN.git在构建Pytorch扩展之前,请确保您具有<代码> Pytorch祝辞=1.0.0 :

<>之前,美元python -c “import 手电筒;,打印(torch.__version__)“生成Pytorch扩展:

<>之前,美元cd 龙骑士达因 美元,cd my_package 以前,美元。/build.sh生成,PWCNet 所需的相关包:

<>之前,美元cd . ./PWCNet/correlation_package_pytorch2_0 美元。/构建。sh测试预训练模型:

制作模型权重目录和明德数据集目录:

<>之前,美元cd 龙骑士达因 美元,mkdir model_weights 美元,mkdir MiddleBurySet下载预训练的模型,

<>之前,美元cd model_weights 美元,wget http://vllab1.ucmerced.edu/~ wenbobao/龙骑士达因/best.pth和明德数据集:

<>之前,美元cd . ./MiddleBurySet 美元,wget http://vision.middlebury.edu/flow/data/comp/zip/other-color-allframes.zip 美元,unzip other-color-allframes.zip 美元,wget http://vision.middlebury.edu/flow/data/comp/zip/other-gt-interp.zip 美元,unzip other-gt-interp.zip 美元,cd …