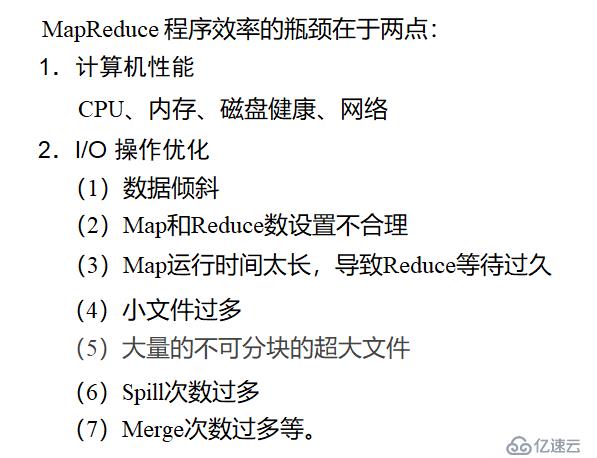

1 MapReduce跑的慢的原因

2 MapReduce优化方法

MapReduce优化方法主要从六个方面考虑:数据输入,地图阶段,减少阶段,IO传输,数据倾斜问题和常用的调优参数。

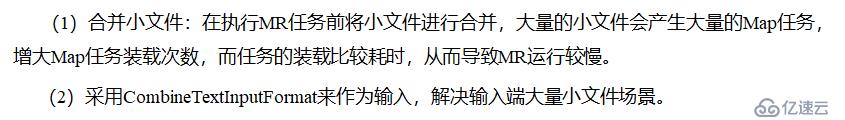

2.1数据输入

2.2地图阶段

2.3减少阶段

2.4 IO传输

2.5数据倾斜问题

2.6常用的调优参数

2.6.1资源相关参数

以下参数是在用户自己的应先生用程序中配置就可以生效(mapred-default.xml)

配置参数 参数说明 mapreduce.map.memory.mb 一个MapTask可使用的资源上限(单位:MB),默认为1024。如果MapTask实际使用的资源量超过该值,则会被强制杀死 mapreduce.reduce.memory.mb 一个ReduceTask可使用的资源上限(单位:MB),默认为1024。如果ReduceTask实际使用的资源量超过该值,则会被强制杀死 mapreduce.map.cpu.vcores 每个MapTask可使用的最多cpu核心数目,默认值:1 mapreduce.reduce.cpu.vcores 每个ReduceTask可使用的最多cpu核心数目,默认值:1 mapreduce.reduce.shuffle.parallelcopies 每个减少去地图中取数据的并行数。默认值是5 mapreduce.reduce.shuffle.merge.percent 缓冲区中的数据达到多少比例开始写入磁盘。默认值0.66 mapreduce.reduce.shuffle.input.buffer.percent 缓冲大小占减少可用内存的比例。默认值0.7 mapreduce.reduce.input.buffer.percent 指定多少比例的内存用来存放缓冲中的数据,默认值是0.0应该在纱启动之前就配置在服务器的配置文件中才能生效(yarn-default.xml)

配置参数 参数说明 yarn.scheduler.minimum-allocation-mb 给应用程序容器分配的最小内存,默认值:1024 yarn.scheduler.maximum-allocation-mb 给应用程序容器分配的最大内存,默认值:8192 yarn.scheduler.minimum-allocation-vcores 每个容器申请的最小CPU核数,默认值:1 yarn.scheduler.maximum-allocation-vcores 每个容器申请的最大的CPU核数,默认值:32 yarn.nodemanager.resource.memory-mb 给容器分配的最大物理内存,默认值:8192洗牌性能优化的关键参数,应在纱启动之前就配置好[mapred-default.xml]

配置参数 参数说明 mapreduce.task.io.sort.mb 洗牌的环形缓冲区大小,默认100米 mapreduce.map.sort.spill.percent 环形缓冲区溢出的阈值,默认80%