这篇文章将为大家详细讲解有关如何用python抓取js生成的页面,小编觉得挺实用的,因此分享给大家做个参考,希望大家阅读完这篇文章后可以有所收获。

之前我们爬取的网页,多是HTML静态生成的内容,直接从HTML源码中就能找到看到的数据和内容,然而并不是所有的网页都是这样的。

有一些网站的内容由前端的JS动态生成,由于呈现在网页上的内容是由JS生成而来,我们能够在浏览器上看得到,但是在HTML源码中却发现不了。比如今日头条:

浏览器呈现的网页是这样的:

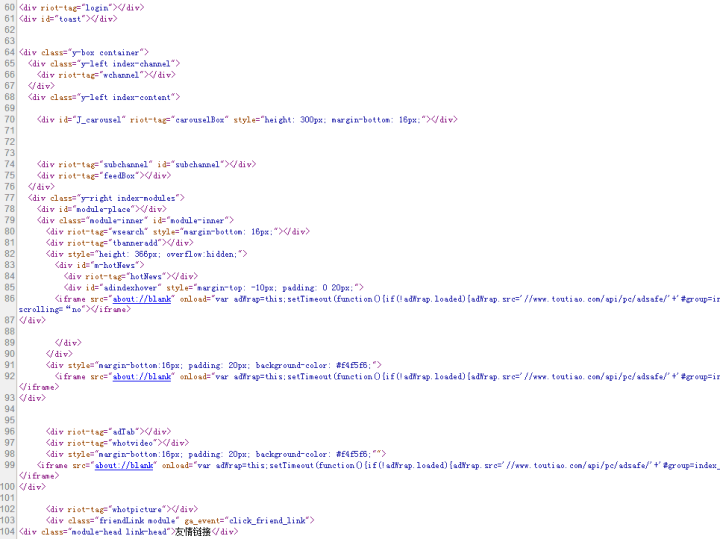

查看源码,却是这样的:

网页的新闻在HTML源码中一条都找不到,全是由JS动态生成加载。

遇到这种情况,我们应该如何对网页进行爬取呢?有两种方法:

1、从网页响应中找到JS脚本返回的JSON数据;2、使用Selenium对网页进行模拟访问

一、从网页响应中找到JS脚本返回的JSON数据

即使网页内容是由JS动态生成加载的,JS也需要对某个接口进行调用,并根据接口返回的JSON数据再进行加载和渲染。

所以我们可以找到JS调用的数据接口,从数据接口中找到网页中最后呈现的数据。

就以今日头条为例来演示:

1、从找到JS请求的数据接口

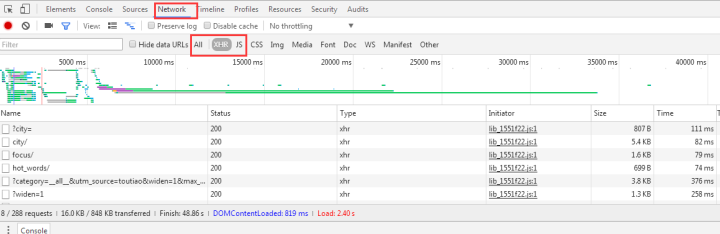

F12打开网页调试工具

选择“网络”选项卡后,发现有很多响应,我们筛选一下,只看XHR响应。

(XHR是Ajax中的概念,表示XMLHTTPrequest)

然后我们发现少了很多链接,随便点开一个看看:

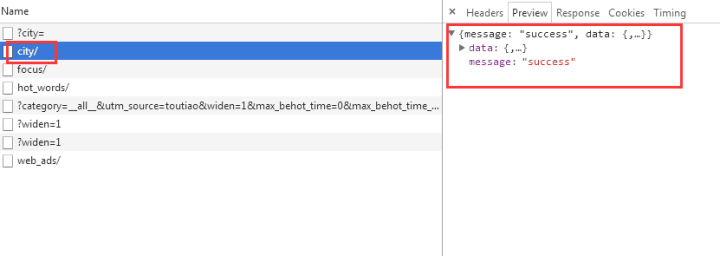

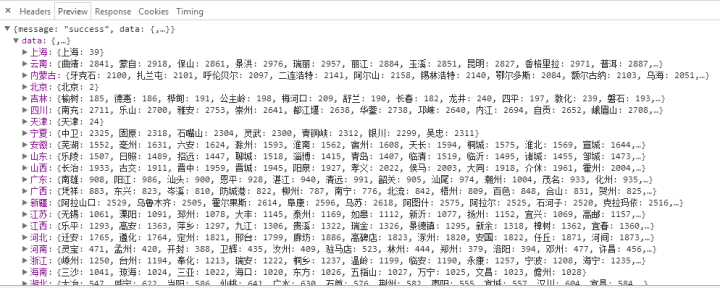

我们选择city,预览中有一串json数据:

我们再点开看看:

原来全都是城市的列表,应该是加载地区新闻之用的。

现在大概了解了怎么找JS请求的接口的吧?但是刚刚我们并没有发现想要的新闻,再找找看:

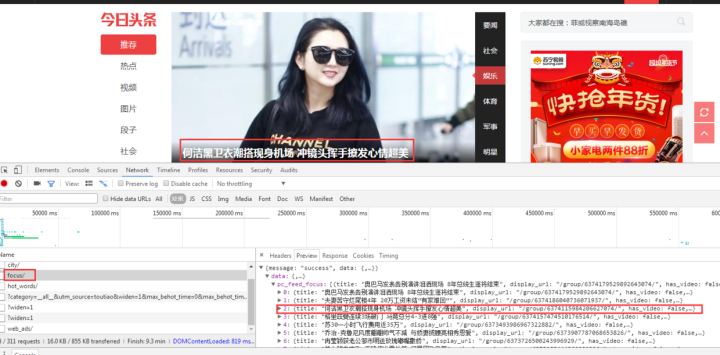

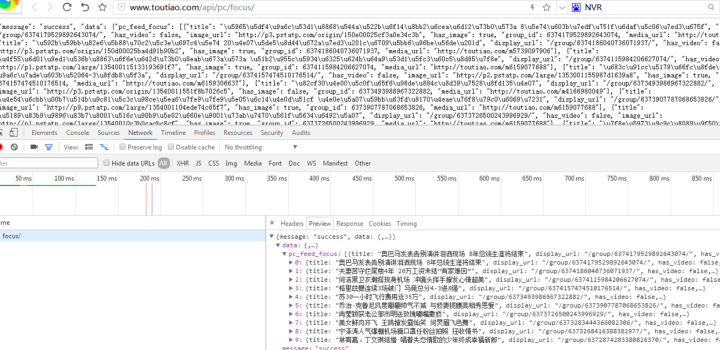

有一个focus,我们点开看看:

与首页的图片新闻呈现的数据是一样的,那么数据应该就在这里面了。

看看其他的链接:

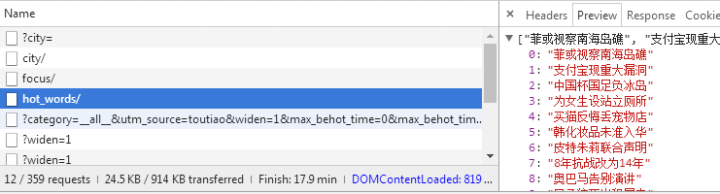

这应该是热搜关键词

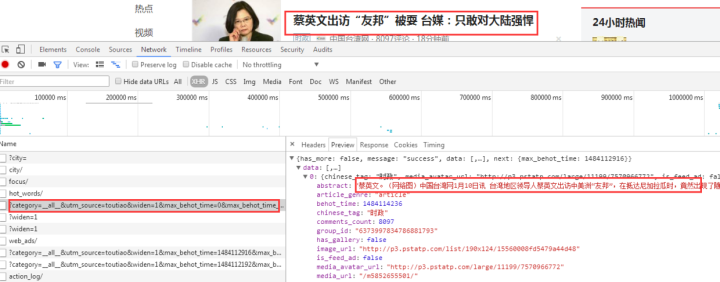

这个就是图片新闻下面的新闻了。

我们打开一个接口链接看看:http://www.toutiao.com/api/pc/focus/

返回一串乱码,但从响应中查看的是正常的编码数据:

有了对应的数据接口,我们就可以仿照之前的方法对数据接口进行请求和获取响应了

2、请求和解析数据接口数据

先上完整代码:

# coding:utf-8 import 请求 import json 时间=url & # 39; http://www.toutiao.com/api/pc/focus/& # 39; 时间=wbdata requests.get。text (url) 时间=data json.loads (wbdata) 时间=news 数据(& # 39;数据# 39;][& # 39;pc_feed_focus& # 39;】 for n 拷贝消息:,,,, title 才能=,n[& # 39;标题# 39;),,,, img_url 才能=,n [& # 39; image_url& # 39;),,,, url 才能=,n [& # 39; media_url& # 39;),,,, 打印才能(url、标题、img_url)

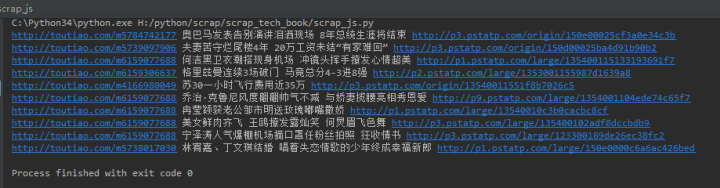

返回出来的结果如下: