介绍得到pandas import DataFrame

得到pandas import DataFrame

import pandas as pd

import matplotlib.pyplot as plt

得到sklearn import linear_model数据集

,

X=[]

Y=[]

with 开放(“C: \ \ \ \ www \ \用户ex1data1.txt",“r"), as f:,, #读取txt文件。

,for line f:拷贝

p_tmp,才能,E_tmp =,(浮动(i), for 小姐:拷贝line.split (& # 39; & # 39;))

X.append才能(p_tmp)

Y.append才能(E_tmp)

,# & # 39;数据=https://www.yisu.com/zixun/np.loadtxt (ex1data1.txt,分隔符=" ") #, X=数据[0] #, Y=数据[1] data=https://www.yisu.com/zixun/DataFrame (X,列={a})

数据[b]=b

X=DataFrame (X)

无花果=plt.figure ()

ax?=fig.add_subplot (1, 1, 1)

plt.scatter(数据[a], [b]) #显示X, Y的散点图

predict_value def linear_model_main (X, Y): #定义一个使用线性回归的函数

regr=linear_model.LinearRegression ()

regr.fit (X, Y) #训练模型

predict_output=regr.predict (predict_value) #预测

预测={}#用一个集合装以下元素

预测[“拦截”]=regr.intercept_ #截距

[' codfficient ']=regr预测。coef_ #斜率(参数)

预测[' predict_value ']=predict_output #预测值

回归预测

结果=linear_model_main (X, Y, 1500) #调用函数

print(结果[' predict_value '])

def show_predict (X, Y):

regr=linear_model.LinearRegression ()

regr.fit (X, Y)

plt.scatter (X, Y,颜色=袄丁?

plt.plot (X, regr.predict (X),颜色='红色')

show_predict (X, Y)

这篇文章主要介绍了python怎么实现简单的单变量线性回归方法,具有一定借鉴价值,感兴趣的朋友可以参考下,希望大家阅读完这篇文章之后大有收获、下面让小编带着大家一起了解一下。

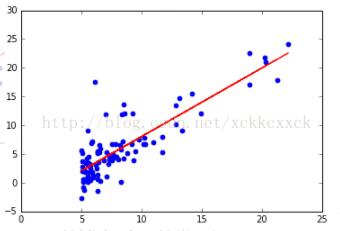

线性回归是机器学习中的基础算法之一,属于监督学习中的回归问题,算法的关键在于如何最小化代价函数,通常使用梯度下降或者正规方程(最小二乘法),在这里对算法原理不过多赘述,建议看吴恩达发布在斯坦福大学上的课程进行入门学习。

这里主要使用python的sklearn实现一个简单的单变量线性回归。

sklearn对机器学习方法封装的十分好,基本使用,预测,分数,来训练,预测,评价模型,

<强>一个简单的事例如下:

<强>最后拟合结果如图:

感谢你能够认真阅读完这篇文章,希望小编分享的“python怎么实现简单的单变量线性回归方法”这篇文章对大家有帮助,同时也希望大家多多支持,关注行业资讯频道,更多相关知识等着你来学习!