介绍 import gensim,,日志记录、操作系统

logging.basicConfig(格式=& # 39;% (asctime) s :, % (levelname) s :, %(消息)& # 39;,,水平=logging.INFO)

import nltk

时间=corpus nltk.corpus.brown.sents ()

时间=fname & # 39; brown_skipgram.model& # 39;

if os.path.exists(帧):

#,才能load 从而file if it has already been 训练,,用节省;repeating 从而slow training step 下面

时间=model 才能;gensim.models.Word2Vec.load(帧)

其他:

#才能,还要take a few 分钟,grab a 一杯茶

model 才能=,gensim.models.Word2Vec(语料库,大?100,min_count=5,,工人=2,,iter=50)

model.save才能(帧)

时间=words “woman women man girl boy green blue" .split ()

for w1 拷贝的话:

for 才能;w2 拷贝的话:

,,,print (w1, w2, model.similarity (w1, w2))

打印(model.most_similar(积极=[& # 39;女人# 39;,,& # 39;& # 39;],,topn=1))

print (model.similarity(& # 39;女人# 39;,,& # 39;女孩# 39;))女孩

这篇文章将为大家详细讲解有关Python实现word2Vec模型过程解析,小编觉得挺实用的,因此分享给大家做个参考,希望大家阅读完这篇文章后可以有所收获。

这篇文章主要介绍了Python实现word2Vec模型过程解析,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友可以参考下

在gensim模块中已经封装了13年提出的模型——word2vec,所以我们直接开始建立模型

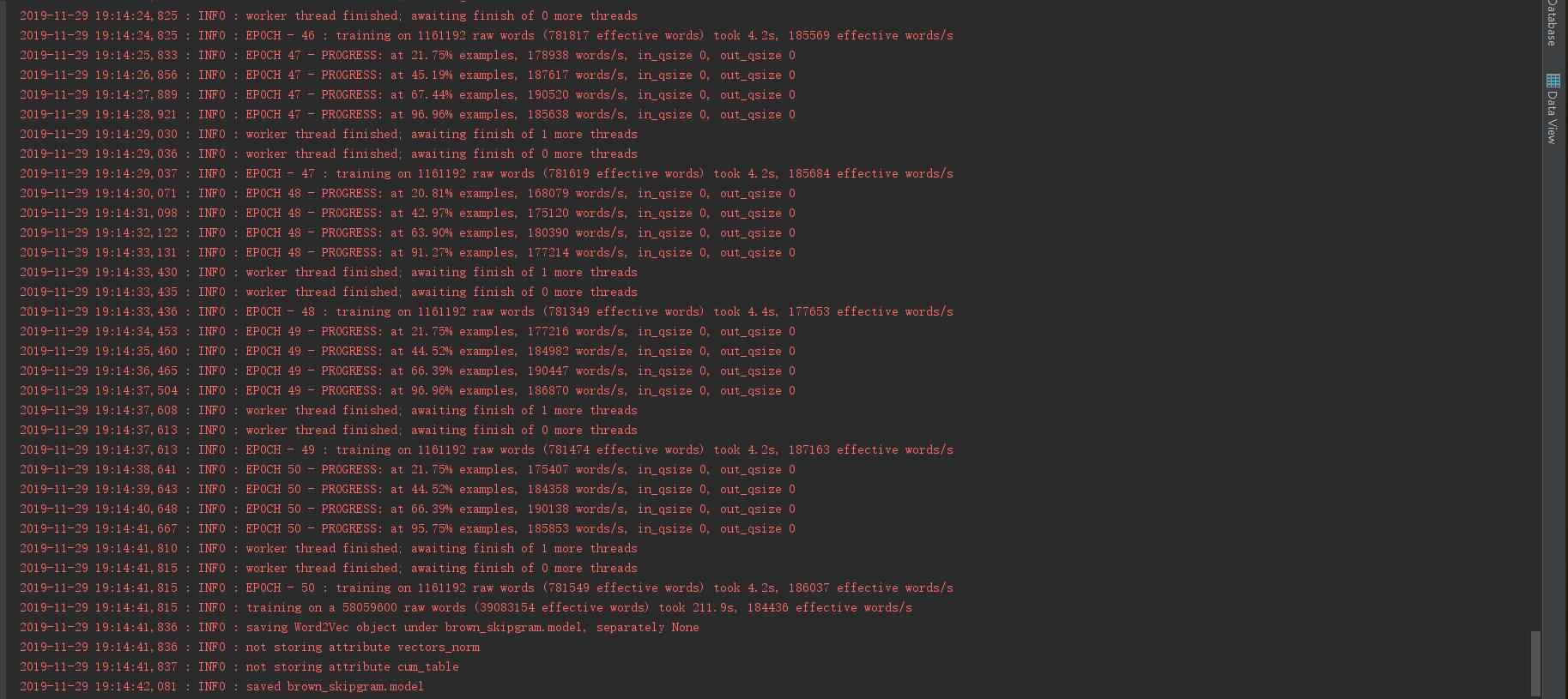

这是建立模型的过程,最后会出现保存word2vec的语句,代表已经成功建立了模型

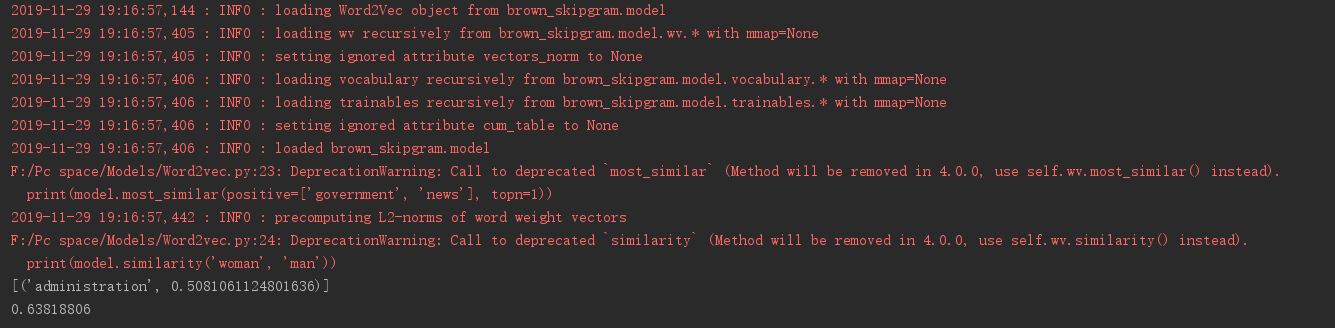

这是输入了gorvement和新闻关键词后所反馈的词语——政府,他们之间的相关性是0.508

当我在输入女人和男人,他们显示的相关性的0.638,已经是非常高的一个数字。

值得一提的是,我用的语料库是直接从nltk里的布朗语料库。其中大概包括了一些新闻之类的数据。

大家如果感兴趣的话,可以自己建立该模型,通过传入不同的语料库,来calc一些术语的相关性噢

关于“Python实现word2vec模型过程解析”这篇文章就分享到这里了,希望以上内容可以对大家有一定的帮助,使各位可以学到更多知识,如果觉得文章不错,请把它分享出去让更多的人看的到。