一、概述

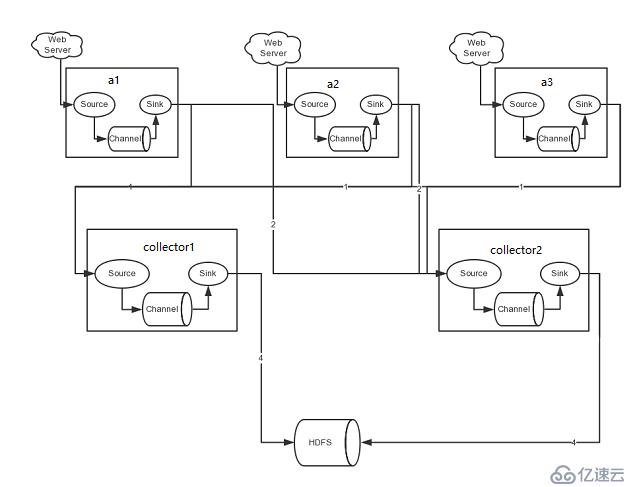

1。通过搭建高可用水槽来实现对数据的收集并存储到hdfs上,架构图如下:

二,配置代理

1。猫flume-client。属性

# name 从而components 提醒却;能够agent ,声明源,通道,水槽的名称 时间=collector1.sources r1 , collector1.channels =, c1 时间=collector1.sinks k1 , ,, #,Describe 从而,source ,,声明源的类型为avro 时间=collector1.sources.r1.type avro , collector1.sources.r1.port =, 5150,, 时间=collector1.sources.r1.bind 0.0.0.0 , 时间=collector1.sources.r1.channels c1 , ,, ,, #,Describe channels c1 which buffers events 拷贝memory 指定通道的类型为内存模式 时间=collector1.channels.c1.type memory , collector1.channels.c1.capacity =, 1000,, collector1.channels.c1.transactionCapacity =, 100,, ,, #,Describe 从而,sink k1 用hdfs ,指定水槽数据流向hdfs 时间=collector1.sinks.k1.type hdfs , 时间=collector1.sinks.k1.channel c1 , collector1.sinks.k1.hdfs.path =, hdfs://主/用户/水槽/日志 时间=collector1.sinks.k1.hdfs.fileType DataStream , 时间=collector1.sinks.k1.hdfs.writeFormat TEXT , collector1.sinks.k1.hdfs.rollInterval =, 300,, 时间=collector1.sinks.k1.hdfs.filePrefix Y % - % - % d , 时间=collector1.sinks.k1.hdfs.round true , 时间=collector1.sinks.k1.hdfs.roundValue 5,, 时间=collector1.sinks.k1.hdfs.roundUnit minute , 时间=collector1.sinks.k1.hdfs.useLocalTimeStamp 真正的

#

2。在

五、测试