像iqiyi这种视频网站,现在下载视频都需要下载相应的客户端。那么如何不用下载客户端,直接下载非贵宾视频?

选择你想要爬取的内容

该安装的程序以及运行环境都配置好

下面这段代码就是我在爱奇艺里搜素“英文名”,然后出来的视频,共20页有,那么我们便从第一页开始,解析网页,然后分析

分析每一页网址,找出规律就可以直接得到所有页面

然后根据每一个视频的URL的标签,如“类”的div“href”……通过bs4库进行爬取

而其他的信息则是直接循环所爬取到的URL,在每一个里再通过标签去找

进口的要求

熊猫作为pd导入

从bs4进口BeautifulSoup

#爬取URL

头={“用户代理”:“Mozilla/5.0 (Windows NT 10.0;Win64;x64) AppleWebKit/537.36 (KHTML,像壁虎)Chrome/79.0.3945.79 Safari/537.36 '}

b=[]

我的范围(1、2):

url=" https://so.iqiyi.com/so/q_英文名_ctg_t_0_page_”+ str (i) +“_p_1_qc_0_rd__site__m_1_bitrate_”#共20页,根据每页的网址变换规律进行拼接

r=requests.get (url,头=标题)

汤=BeautifulSoup (r.text“html.parser”)=soup.findAll (a{“类”:“main-tit”})

因为我在一个:

如果在i.get“http://www”。(“href”)和“i.get html除(“href”):

b.append (i.get (“href”))

打印(b)

#爬取标题

e=[]

对k b:

res=requests.get (k,头=标题)

汤=BeautifulSoup (res.text html.parser)

c=Soup.findAll (" div "{“类”:“feed-title-box”})

在c: d

e.append (d.find (h2)。text)

打印(e)

#爬取标题下方描述

f=[]

b: j的

res=requests.get (j,头=标题)

汤=BeautifulSoup (res.text html.parser)

c=Soup.findAll (" div "{“类”:“qy-play-intro-feed”})

在c: d

f.append (d.find (“p”,{“类”:“intro-iterm__block”})。text)

打印(f)

#爬取发布时间

h=[]

b: j的

res=requests.get (j,头=标题)

汤=BeautifulSoup (res.text html.parser)

c=Soup.findAll (" div "{“类”:“intro-iterm”})

在c: d

ff=(d.find(“跨度”{“类”:“intro-iterm__txt”}))

如果ff==没有:

继续

h.append (ff.text)

打印(h)

#爬取上传作者

m=[]

对k b:

res=requests.get (k,头=标题)

汤=BeautifulSoup (res.text html.parser)

c=Soup.find (" div " {“id”:“block-P”})

d=Soup.find (" div "{“类”:“qy-player-maker”})

试一试:

name=c.get(':上传).split (" ") [1] .split (“:”) [1] .replace(‘”’,”) #输出是字符串的格式,所以用分切割.replace替换

除了:

试一试:

name=d.get(':上传).split (" ") [1] .split (“:”) [1] .replace (‘”’,”)

除了:

m.append(“匿名用户”)

m.append(名字)

打印(m)

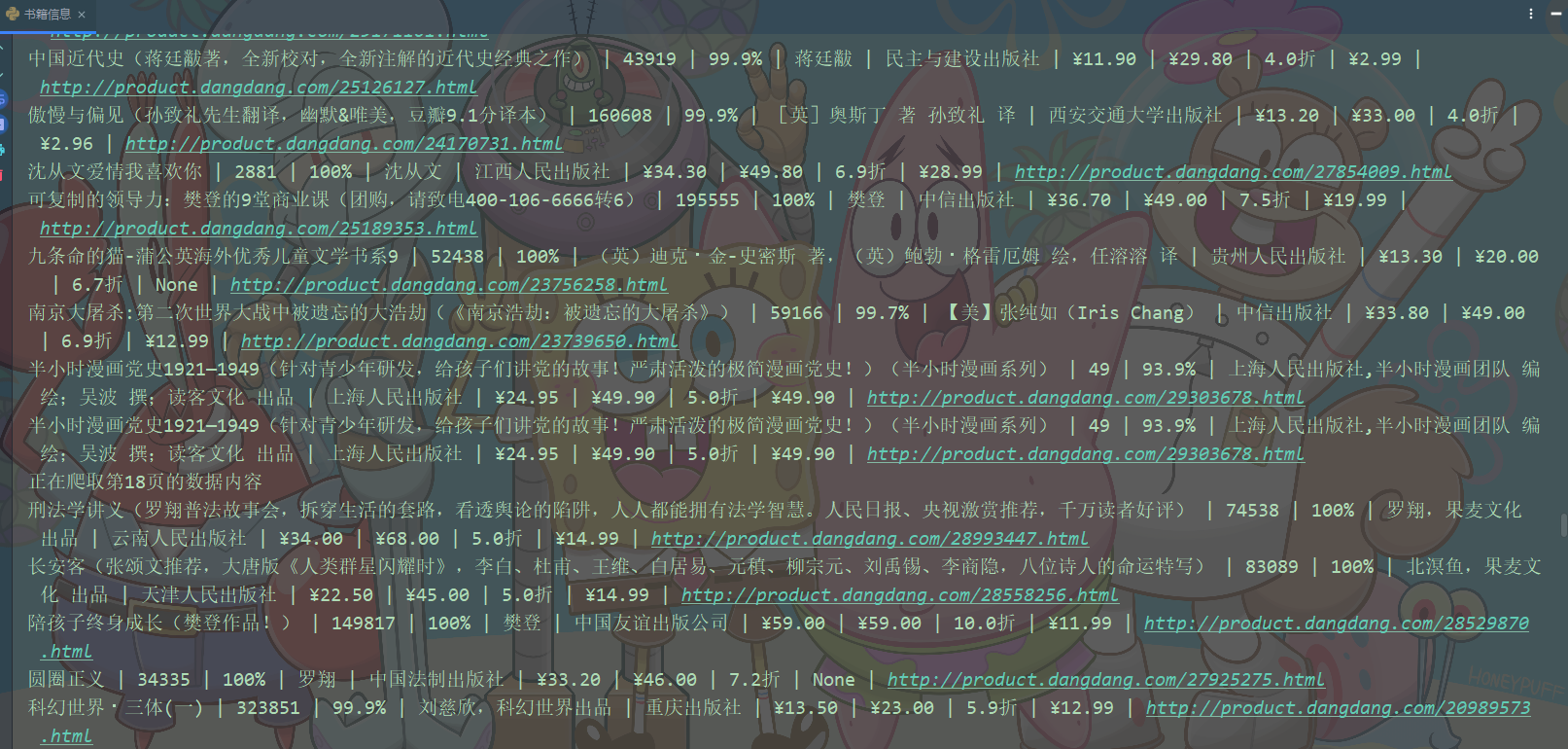

上面的代码输出结果便是英文名的所有网址及其视频中的一些信息

这里我需要讲一下的是,为什么在爬取作者信息的模块里我采取了尝试的方法,因为在我爬取的过程中我发现,有的视频的上传作者在视频左下方,有的在视频的右下方,有的视频干脆没有上传作者。

同样的,你想要爬取其他内容也可以用这种方法获取URL和他的其他信息

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持。